深度|AI 合规难题:Agent 时代的监管与实践

AI 正以前所未有的速度走进企业的生产系统。尤其是 AI Agent 的兴起,让“自动执行”“自主决策”成为现实。

然而,智能体的行动自由越大,带来的合规挑战也愈加复杂:谁来界定它的边界?谁对它的行为负责?如何确保它的决策过程符合监管要求?

这篇文章将从监管趋势、核心风险、企业落地实践三个层面,探讨 Agent 时代的合规难题,并结合九科信息的 bit-Agent 产品,看看企业如何在智能化转型中找到“可控的自由度”。

一、为什么AI Agent的合规问题比模型更复杂

过去,合规讨论的焦点主要集中在模型本身:是否偏见?是否透明?是否侵犯隐私?

而现在,AI Agent 不仅能“说”,还能“做”。它能读懂指令、调取接口、修改数据库、自动执行任务。

在这种多层行动链中,合规风险也随之放大:

- 一次模糊指令,可能触发真实系统操作;

- 一次模型更新,可能改变Agent的行为逻辑;

- 一次外部模型调用,可能带来跨境数据问题。

AI Agent 不再只是一个“语言工具”,而是一个能主动行动的“数字员工”。

这意味着:它必须被纳入更完整的合规监管体系中。

二、AI Agent的五大合规挑战

1. 高风险系统分类:从能力到责任的界定

欧盟《AI法案》(EU AI Act)已经正式将 AI 系统划分为“最小风险、有限风险、高风险、禁止使用”四类。

其中,“高风险系统”包括与金融、医疗、教育、执法等关键领域相关的智能系统。

而 AI Agent 的能力往往跨越多个业务场景,比如既能分析合同,又能生成决策建议。

这就使它天然具备“高风险潜力”。

企业必须在部署前明确:

哪些任务属于监管高风险?Agent在执行中是否可能接触敏感决策?

只有建立一套能力与风险映射体系,才能在根源上避免“误入红线”。

2. 可解释性与审计链追踪

监管机构对 AI 的一项核心要求是:“Explainable AI”——可解释性。

这在AI Agent场景下尤为关键。

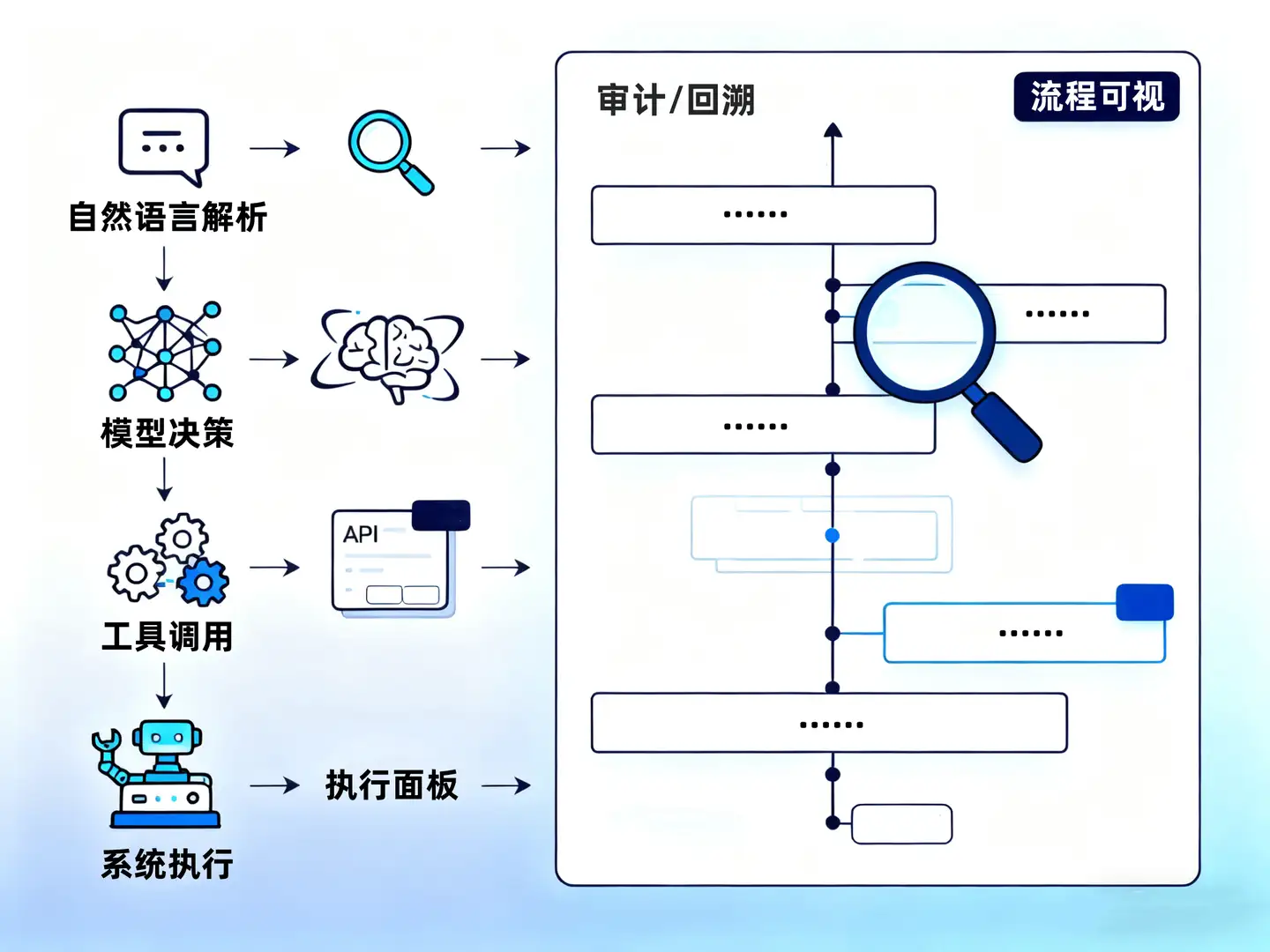

因为Agent的决策往往跨越多个层次:

从自然语言解析 → 模型决策 → 工具调用 → 系统执行。

若没有完整的记录,企业将难以复盘“Agent 为什么做出这个决定”。

AI Agent决策全链条

理想的合规机制应包括:

- 记录每一次 Prompt 输入与响应输出;

- 追踪每一步调用的工具、接口、参数;

- 对执行结果进行日志签名与版本存档。

只有这样,当出现问题时,企业才能“回看一切”,明确责任链条。

3. 数据隐私与跨境合规

AI Agent 在执行任务时,会大量接触内部数据。

当这些数据被模型“看见”或“学习”后,可能触发隐私泄露风险。

合规的关键,是遵循“数据最小化”和“边界隔离”两大原则:

- 仅在必要范围内让 Agent 访问数据;

- 对外部模型调用进行脱敏或摘要化处理;

- 对跨境请求建立数据防火墙,防止隐性出境。

在监管日趋严格的背景下(例如中国《数据安全法》《个人信息保护法》、欧盟 GDPR),AI Agent的数据安全合规已成为企业能否大规模部署的前提。

4. 责任归属:谁为Agent的决定负责?

AI Agent的一个最大特征是“自主执行”,这意味着它可能会自行做出业务判断。

当出现误判、数据丢失、财务损失时,责任归属便成为争议焦点。

目前主流的做法是:

在关键决策链引入“人工在环(Human-in-the-loop)机制”。

即在高风险操作(如审批、合同签署、资金流转)中,Agent的结果必须经由人工复核才能执行。

这不仅是审慎防线,更是法律意义上的责任转移机制。

AI Agent主流治理模式——人机共治

5. 模型治理与版本控制

AI Agent 常常需要调用不同的大模型来完成不同任务,比如 DeepSeek 负责结构化理解,GPT-4o 负责自然语言生成。

若这些模型频繁更新或切换,就可能导致行为不一致。

合规视角下,这意味着:

- 每次模型替换都应登记、审批、测试;

- 模型版本需与执行日志绑定;

- 模型漂移、输出异常应有监测与警报机制。

只有将“模型治理”纳入 Agent 管理体系,企业才能实现可审计、可复盘的智能治理。

三、企业的合规落地路径

1. 绘制AI Agent合规风险地图

将所有Agent功能按业务风险分层分类;

对高风险节点设立人工审核机制。

2. 建立合规则引擎(Compliance Engine)

在Agent调用层植入合规则拦截模块;

动态校验每个任务是否符合安全策略。

3. 全链路日志与可视化审计

建立统一Dashboard,实时追踪Agent行为。

支持按操作人、模型、任务类型回溯。

4. 人机共治机制(Governance in the Loop)

在关键节点引入人工确认;

对错误任务支持人工干预与回滚。

四、bit-Agent的合规实践样本

九科信息的 bit-Agent 在企业级AI落地中,已将“合规则设计”内嵌于产品架构:

- 角色与权限分级体系:bit-Agent支持细粒度权限配置,每个Agent实例仅能访问授权范围的数据与接口,防止越权调用。

- 多模型调度安全治理:bit-Agent支持DeepSeek、GPT-4o等多种大模型,采用多模型隔离与任务级审计机制,确保跨模型操作合规。

- 全链路可追溯日志:每一次Prompt输入、模型调用、执行结果都自动记录,便于合规审计与责任追踪。

- 人工在环机制:在高风险任务(如文档审批、客户画像)中,bit-Agent会自动触发人工复核节点,实现“AI辅助、人类决策”的模式。

这些特性,使bit-Agent不仅是一个智能执行平台,更是企业合规治理的技术载体。

五、展望:让合规成为AI Agent的底层能力

AI Agent 的未来,不是“谁能跑得更快”,而是“谁能跑得更稳”。

合规,不仅是企业对外的“护城河”,更是对内的“自律系统”。

未来的趋势将是:

- 合规则自动化:AI Agent自动识别高风险任务并调整执行策略;

- 合规即服务:合规则引擎与审计模块成为平台标准组件;

- 合规协同生态:模型厂商、安全厂商、监管机构共同定义标准。

九科信息 bit-Agent 正在探索的,正是这一方向——

让 AI Agent 在能力不断扩展的同时,拥有清晰可控的边界。

真正的智能,不是没有限制,而是在限制中实现自我进化。