深度|AI Agent如何处理场景异常并自我优化?

真实企业环境里,打断自动化的往往不是概念性问题,而是那些“现场变数”——界面微调、临时权限变更、网络抖动、字段被隐藏,或人为调整业务规则。要让 AI Agent 真正做到“跑得稳、越跑越聪明”,核心在于遇到异常时的反应路径与后续学习机制。AI Agent如何发现、如何决策、如何修复、如何把每一次修复变成可复用的“经验”,从而实现自我优化呢?

一、将异常视为结构化信号:多通道感知与快速定位

传统自动化往往只在“任务失败”时抛出错误,而无法为后续优化提供可用信息。AI Agent 的第一条原则是把异常看成“待吸收的信息”并进行结构化保存。具体做法包括:

- 多模态异常感知:同时采集视觉(截图、像素/特征比对)、界面结构(DOM/控件树或控件标识)、后端响应码与日志、网络请求超时/失败等多通道信号,避免单一指标误判。

- 细粒度特征记录:异常不只记录“失败”,而是记录发生时间、触发前的输入、操作序列、界面快照与后端返回体等,用于后续定位与分析。

- 异常分类优先级:快速判断是视觉层(元素不可见或位置变动)、逻辑层(数据校验失败、格式变更)还是外部依赖(接口超时、权限变更),为下一步处理提供方向。

这种结构化的“事发快照”让后续的决策与学习有据可依,而不是盲目的试错。

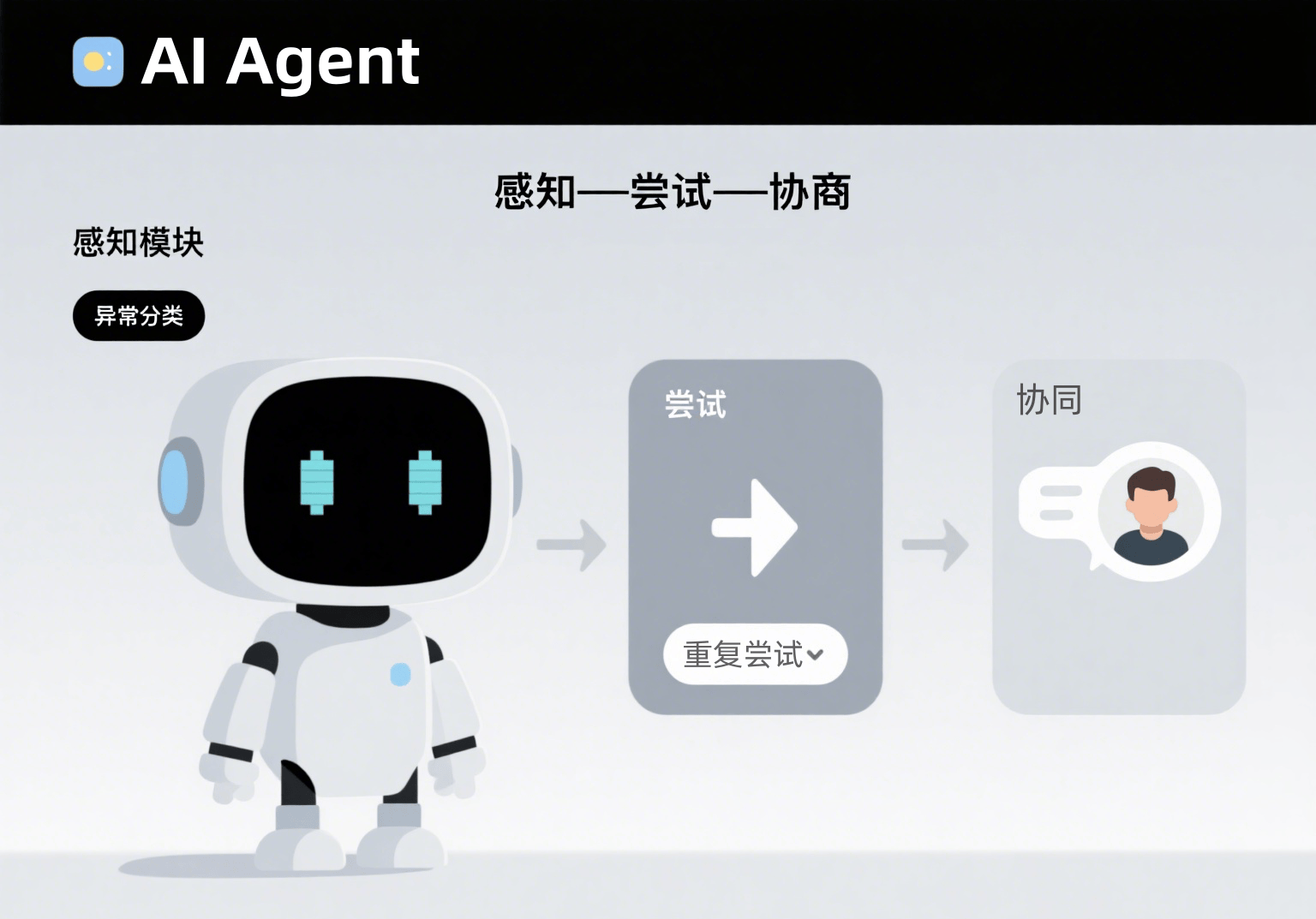

二、受控应对:从自动试探到人机协商的三段式策略

发现异常只是第一步,关键在如何安全、有效地应对。AI Agent可“感知—尝试—协商”的受控流程,兼顾自动化覆盖率与风险控制。

- 感知:快速定位异常类型

通过多通道校验在短时间内确认异常归类(视觉/逻辑/外部),避免误判导致不必要的操作中断或危险指令执行。

- 尝试:受控试探以恢复流畅度

在明确定义的安全边界内自动进行替代操作:如尝试备用按钮、模拟键盘输入、回退一步后再试、重试网络请求等。每种试探都有预设限制(最大重试次数、黑名单操作、并发上限),防止“越试越坏”。多数界面微调或临时波动可通过这种受控试探被自动绕过。

- 协商:必要时把决策交回人类

当自动试探无法稳妥解决或涉及高风险操作时,AI Agent会以简洁的证据包(截图+差异点+备选方案)向运维或业务方发起交互,推荐可行选项并记录用户选择。用户确认后,Agent会将该选择路径编码成可复用的规则或模板。

这种“先试、再协商、后固化”的流程在保证自动化效率的同时,保留了必要的人类审判权,构成稳健的安全阀。

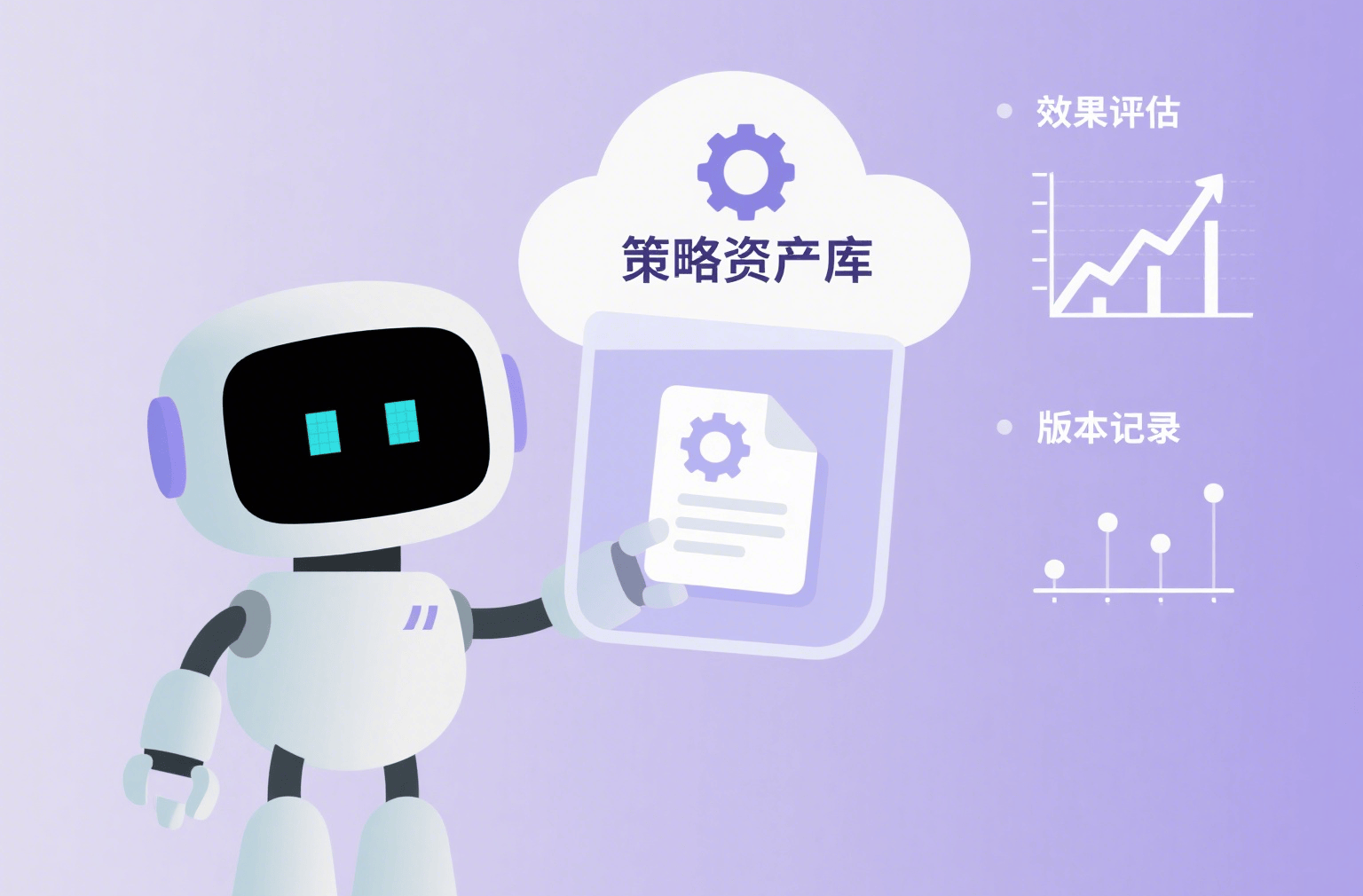

三、策略资产化:把每次应急转化为长期可复用能力

一个成熟的自学习系统必须把“临时救火”变成“长期资产”。AI Agent在应急处理后,主要通过三条机制把经验固化起来:

- 模板化策略:把成功的应对路径抽象为策略模板,包括触发条件、操作序列与回退方案。未来遇到相似触发条件时优先调用模板,避免重复试错。

- 效果评估与优先级学习:记录不同解决方案的效果指标(成功率、耗时、对上下游影响),根据实际表现动态调整策略优先级。表现优异的策略会被置于高优先级,糟糕策略会被降级或进入复盘队列。

- 版本与审计机制:每次策略更新都会生成版本记录,支持回滚与 A/B 验证,防止“自学习漂移”。只有通过业务或安全审批的模板才能在生产线上正式生效,保证治理可控。

通过这些步骤,零散的异常处理路径被系统化、可管理并纳入审计闭环,从而提升长期稳定性。

四、安全训练与评价体系:影子运行、沙盒回放与过程质量监控

把系统直接用于生产环境训练代价高且风险大。为降低风险并验证自学习策略的可靠性,一款足够优秀的 AI Agent通常可以采用以下安全训练与评估实践:

- 影子运行:在真实流量旁路并行执行但不影响实际操作,用以评估自动处理策略在真实负载下的表现,统计自动修复率与误判率,发现潜在问题。

- 沙盒回放:将历史成功与失败的操作序列在沙盒环境中复现,用于训练与验证决策模型,快速迭代而不干扰业务系统。

- 过程质量维度化:评价异常处理不只看最终是否完成任务,还要考察过程质量指标(如触发安全边界频率、人工介入率、平均修复时间、对下游流程的影响等),并将这些指标纳入常态仪表盘,作为策略更新或回退的触发条件。

- 审计与可解释性:在关键决策点保留“决策快照”(触发条件、候选方案、选择理由与执行证据如截图/日志),便于合规审查、问题回溯与人工复核。

这些以安全为先、以质量为驱动的做法,不能绝对消除所有风险,但能显著降低自学习带来的不可控性,并为业务方提供可评估、可回退的治理能力。

五、安全落地建议

- 先做小规模试点:选择低风险、高频次的任务积累异常样本。

开启影子模式一段时间:并行运行评估自动修复率与误判率,再逐步扩大覆盖。

- 建立审批链路:所有自动生成的策略纳入业务/安全审批流,未审批策略不得上线。

搭建监控面板:将过程质量指标(人工干预率、平均修复时间、回滚次数等)常态化监控并设阈值告警。

- 定期复盘:把“错题本”作为优化清单,按周期校准模型与模板,确保能力长期可靠。

结语

真正可用的智能体,不是试图避免所有错误,而是把错误变成可管理、可学习的资源。而九科信息的 bit-Agent正是一款这样的企业级GUI Agent,通过“结构化感知+受控试探+人机协作+策略资产化+安全训练”五大要素,使每一次异常都成为系统进化的燃料。这套方法论不仅提升自动化稳定性,更能把企业的“临时救火”能力转化为可持续竞争力。若考虑将智能体投入生产环境,建议从可观测性、可审计性与可回滚性三个维度循序推进,让“偶发事件”逐步变成“长期能力”。